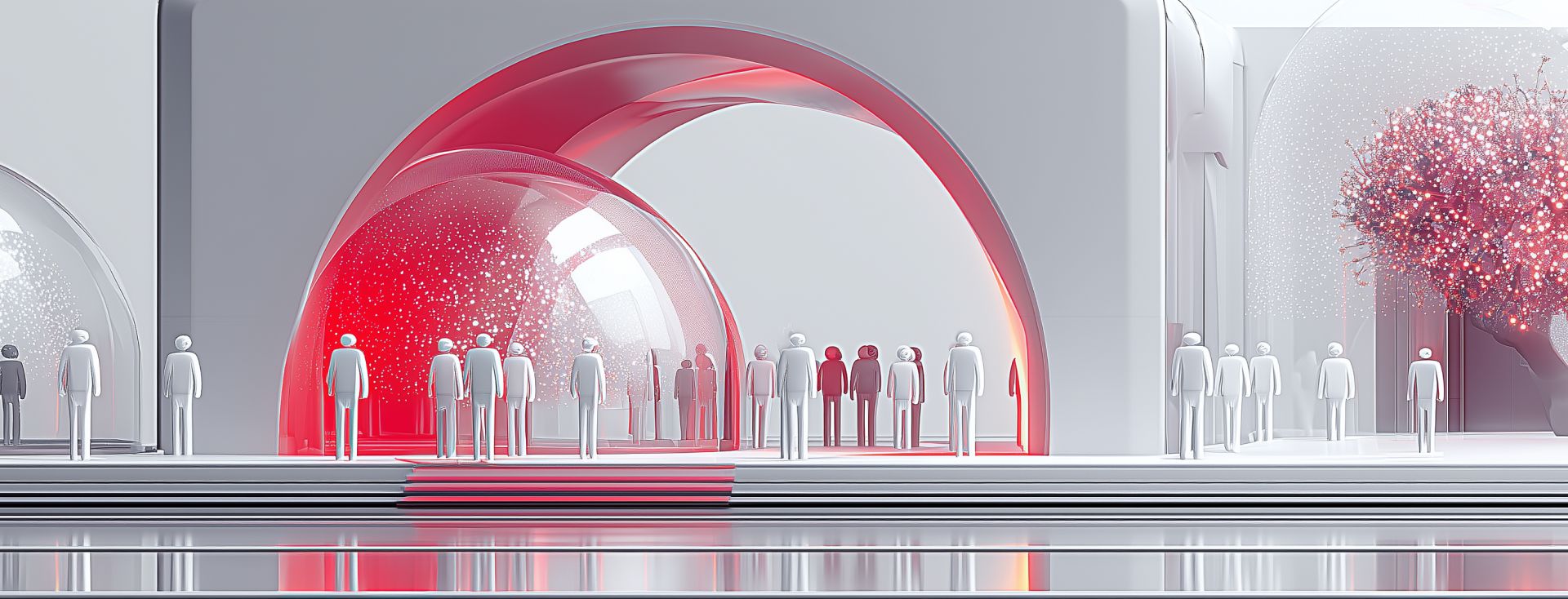

Компания MTS AI представила на конференции ЦИПР результаты опроса, в котором предложила 1600 россиянам в возрасте старше 18 лет определить, какие изображения созданы при помощи нейросетей, а какие являются фотографиями: среди 10 изображений 4 были сгенерированы ИИ, а 6 – реальными снимками.

Ключевые результаты:

- Во всех трех тестах по распознаванию дипфейков человека большинство респондентов (от 62% до 80%) считали сгенерированные специализированным ИИ фото настоящими.

- Из 6 реальных фотографий лишь 3 были отмечены большинством респондентов как подлинные.

| Источник: MTS AI | |

Три из четырех фотографий, созданных ИИ, были сгенерированы специализированной нейросетью для создания дипфейков человека, а четвертая сделана с помощью обычной большой языковой модели на основе текстового описания. Опрос выявил, что изображение, созданное с помощью обычной модели, чаще распознаётся как ненастоящее – 76% опрошенных верно определили, что фотография, созданная нейросетью, — фейк. Это объясняется особенностями целевого назначения моделей — нейросети, разработанные исключительно для генерации лиц, за последние годы научились точно воспроизводить текстуру кожи, симметрию черт и светотеневые переходы, благодаря чему итоговое изображение становится практически неотличимым от реальной фотографии.

Уровень распознавания фотографий, созданных специализированными нейросетями для генерации человеческих лиц, оказался значительно ниже. Все три сгенерированных портрета большинство респондентов приняли за изображения реальных людей — причём в каждом случае правильных ответов было менее 40%. Один из дипфейков 81% участников опроса посчитали фотографией реального человека. Для сравнения: детектор дипфейков Visionlabs корректно идентифицировал все представленные изображения как сгенерированные нейросетями.